Великі міжнародні благодійні організації маніпулюють зображеннями для отримання грантів і донатів

У мережі з’являється дедалі більше зображень, згенерованих штучним інтелектом, на яких зображено дітей або жертв насильства. Як повідомляє The Guardian, ці картинки активно використовують навіть великі міжнародні благодійні та медичні організації у своїх соціальних кампаніях, що викликало хвилю обурення серед експертів.

Що відбувається

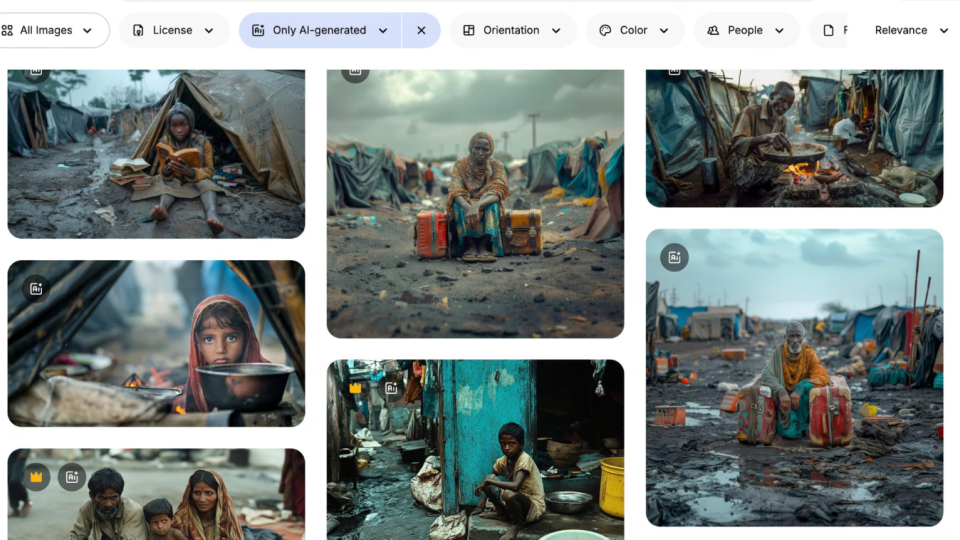

Штучний інтелект масово генерує «реалістичні» фото людей у злиднях, дітей із порожніми тарілками чи дівчат у сльозах, які нібито пережили насильство. Такі зображення продаються на великих стокових платформах і використовуються у благодійних постах та відео.

Дослідник Арсеній Аленічев з Інституту тропічної медицини в Антверпені зібрав понад сотню таких прикладів і назвав це явище «poverty porn 2.0» — експлуатацією образу бідності в новій, цифровій формі.

«Ці картинки відтворюють найгірші стереотипи — темношкірі діти в бруді, розбиті обличчя, старі халупи. Це не реальні люди, але вони формують у глядачів уявлення про «бідний світ», — зазначив експерт.

Чому це небезпечно

Фахівці наголошують, що такі фото поширюють расові й соціальні упередження. За словами Ноа Арнольда з швейцарської організації Fairpicture, яка просуває етичне використання зображень у медіа, «організації почали вдаватися до синтетичних зображень, бо це дешево і не потрібно отримувати згоду на зйомку».

«Мільйони євро урізали з бюджетів НГО, і тепер замість фотографів вони використовують нейромережі», — пояснив Арнольд.

Експерти попереджають: фейкові фото проникають у глобальні бази даних і можуть надалі використовуватись для навчання нових ШІ-моделей, що лише посилить упередження.

Як реагують компанії та організації

На платформах стокових фото вже десятки таких Ші-зображень, які можна купити за кілька десятків доларів. Представник Freepik визнав проблему, але заявив, що «неможливо контролювати всі запити користувачів».

Раніше подібні матеріали використовували навіть міжнародні організації. У 2023 році нідерландський підрозділ Plan International опублікував відео проти дитячих шлюбів із використанням ШІ-зображень, а ООН створила ролик про сексуальне насильство в конфліктах — теж із фейковими сценами. Після критики відео прибрали.

Представник ООН пояснив, що «відео створили з використанням нової технології, яка швидко розвивається, але воно не відповідало етичним стандартам і могло спотворювати інформацію».

Що кажуть фахівці

Комунікаційна консультантка Кейт Кардол назвала такі практики тривожними: «Ми роками боролися за гідне зображення людей, які живуть у бідності. Тепер цю боротьбу доведеться вести і проти вигаданих образів».

Підписуйтесь на наш Telegram-канал t.me/sudua та на Google Новини SUD.UA, а також на наш VIBER, сторінку у Facebook та в Instagram, щоб бути в курсі найважливіших подій.